VIENI A TROVARCI

Sede Operativa:Via Stelvio, 24

23020 Poggiridenti (SO) | ITALIA

Il posizionamento su Google dipende, come abbiamo visto in questa guida, da molteplici fattori “onsite”, ma principalmente dal livello di “Trust” (Fiducia) che il sito internet ottiene dal motore di ricerca. Questa fiducia “incondizionata” viene acquisita nel tempo e dopo molti sforzi quindi è necessario essere sempre attenti a mantenerla inalterata.

Un modo per perderla è quella di ospitare sul proprio sito file considerati “malware” o “spam”; ovviamente nessuna azienda volontariamente li andrebbe ad inserire sul proprio progetto ma capita, e purtroppo sempre più spesso, di essere vittime di attività di “hackering” che manomettono il nostro portale.

Attraverso l’attività di “crawling” possiamo cercare di intercettarla e porci rimedio in tempi brevi prima di trovarci in una condizione di “penalizzazione temporanea”, inflitta da parte del motore di ricerca, o nei casi più gravi di essere “bannati” dalla Serp.

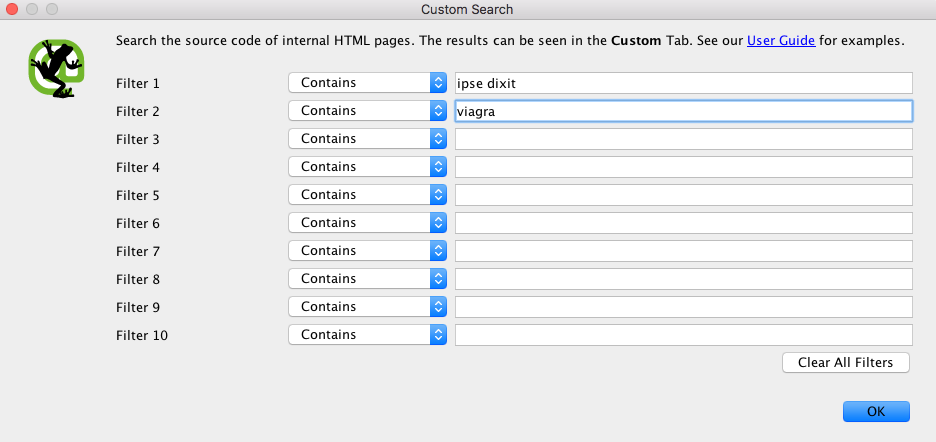

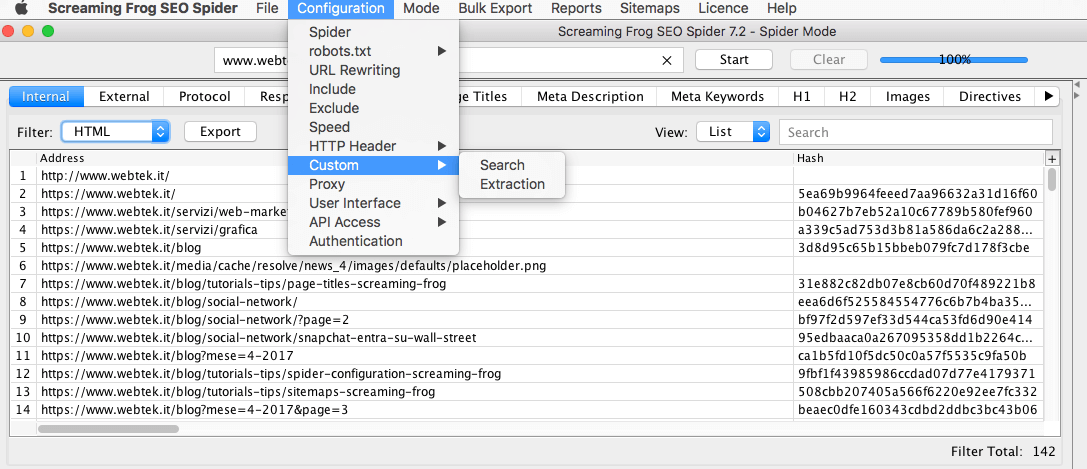

Un metodo per capire se ci siano delle “immissioni” di codice non richiesto può essere fatto attraverso la funzione “Custom”; filtri customizzati che ci permettono di trovare eventuali “footprint” indesiderati.

La suite di Screaming Frog permette l’inserimento fino a 10 filtri; alla fine del “crawling” la console ci restituirà tutte le pagine che contengono il “footprint” nel suo codice “html”.

SEO TIPS: questa funzionalità oltre ad intercettare eventuali “footprint” indesiderati potrebbe essere molto utile per verificare che il sito non preveda ancora dei “placeholder” che erano stati inseriti in fase della progettazione grafica del sito internet (es. “lorem ipsum”...)